Gemini Embedding 2 đã ra mắt và đó là mô hình nhúng đa phương thức (hỗ trợ văn bản, ảnh...).

Thay vì phải tìm cách xử lý cho từng loại dữ liệu, Gemini Embedding 2 đưa tất cả về chung một "không gian vector" để làm tìm kiếm ngữ nghĩa, phân loại, gom cụm dữ liệu, RAG (tăng cường truy hồi cho mô hình sinh)… kiểu đồng bộ hơn và đỡ rối hơn. Hỗ trợ hơn 100 ngôn ngữ, văn bản dài tới 8192 token, mỗi lần có thể nhúng tối đa 6 hình (PNG/JPEG), video tới 120 giây (MP4/MOV), âm thanh và tài liệu PDF tối đa 6 trang.

Họ dùng kỹ thuật "Matryoshka Representation Learning" để cho phép giảm số chiều đầu ra từ mặc định 3072 xuống 1536 hoặc 768 (đổi chất lượng lấy chi phí lưu trữ/tốc độ), nên hợp với mấy hệ thống phải lưu rất nhiều vector.

Hiện model đang ở public preview qua Gemini API và Vertex AI, kèm sẵn notebook để dùng thử.

canirun.ai là một trang web thú vị tổng hợp lại một số cấu hình phần cứng chạy tốt hay không các mô hình ngôn ngữ lớn nguồn mở hiện nay. Điểm thú vị là nó cung cấp thông tin chi tiết về tốc độ sinh tokens trên mỗi giây, để từ đó cung cấp dữ liệu tham khảo cho bạn nếu đang muốn xây dựng một cấu hình vừa đủ chạy mô hình cục bộ cho riêng mình.

Hôm trước mình lướt trúng bài viết này trên Facebook: https://www.facebook.com/share/p/1DYEgsx5Kh/.

Tạo một đoạn mã JavaScript để thêm một mục hiển thị danh sách tin nhắn trong một cuộc hội thoại trên web ChatGPT. Cái này đúng tiện mà lại không nghĩ ra, vì nhiều lúc tin nhắn quá dài mà cứ phải kéo lên mỏi tay, khó theo dõi.

Trong bài viết tác giả chỉ cung cấp prompt để chúng ta "vibe code" ra thôi. Mình thử rồi hiệu quả phết, nhưng vẫn còn một số chỗ có thể cải thiện được thêm. Sắp tới chắc tạo thêm 1 kho lưu trữ trên Github rồi "open source" đoạn mã của mình vì thấy nó khá là thú vị 😁

startups.rip là trang web tổng hợp lại tất cả dự án đã gọi vốn thành công từ Y Combinator (YC) - vốn nổi tiếng trong các khoản đầu tư mạo hiểm trên thế giới. Có rất nhiều dự án trải dài từ 2005 đến ngày nay, thành công có, thất bại cũng có, quan trọng là nó cung cấp thông tin chi tiết về câu chuyện, hành trình và cả lý do thành bại. Rất đáng để đọc.

Cả OpenAI và Anthropic đều có chương trình miễn phí 6 sử dụng gói dịch vụ Pro đến Max dành cho những người bảo trì dự án mã nguồn mở. Trong khi Anthropic yêu cầu dự án có 5.000 sao trên GitHub hoặc hơn 1 triệu lượt tải xuống hàng tháng trên NPM thì OpenAI chỉ đưa ra yêu cầu ở mức chung chung.

Nếu bạn không đạt tiêu chí trên thì vẫn có thể viết "tâm thư" thổ lộ lý do muốn sử dụng các gói tài trợ đó. Điều này thể hiện họ rất sẵn sàng lắng nghe câu chuyện của bạn trong thế giới mã nguồn mở.

Như mình theo dõi thì việc này vẫn vấp phải khá nhiều chỉ trích của cộng đồng, vì theo họ cả 2 ông lớn trên đào tạo mô hình của họ thông qua kho lưu trữ mã nguồn mở nên 6 tháng sử dụng là chưa thoả đáng. Vậy nhưng vẫn có người đứng ra bảo vệ, cho rằng 6 tháng là tương đối hào phóng bởi vì họ thậm chí còn không kiếm được tiền từ việc duy trì dự án mã nguồn mở. Còn bạn thấy thế nào?

Codex for Open Source Thank you for everything you ship. Claude Max is on us

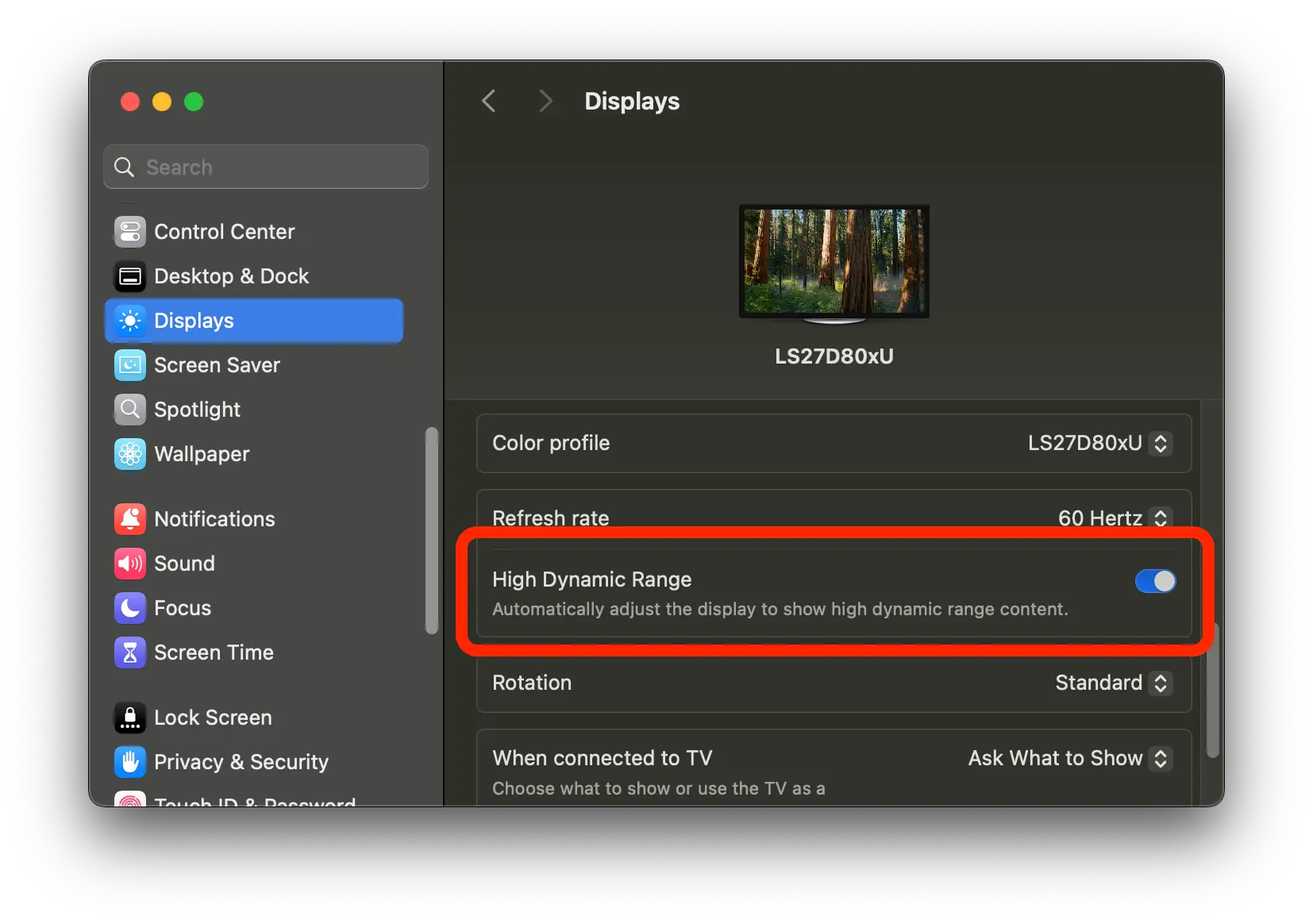

Các bạn dùng MacOS mà kết nối với màn hình ngoài thì để ý xem có tuỳ chọn bật chế độ này lên không nhé! Hôm qua ngựa ngựa thử bật lên thấy màu sắc nó tươi hơn hẳn. Màn thì mua cả năm nay rồi, ViewFinity S8 không đến nỗi nào nhưng cắm vào thấy màu nó cứ bị nhợt nhạt mà không biết tại sao, rõ nhất là đang nhìn màn rời thì quay sang nhìn vào màn Macbook nó khác biệt hẳn. Trong khi chỉnh chế độ trong cài đặt của màn cũng chẳng ăn thua.

Thì ra vấn đề nằm ở nút đấy, quê mùa quá 🫣

Mấy hôm nay đang ngồi thiết lập thêm cảnh báo hệ thống cho một số máy chủ mà mình đang quản lý.

Monit là một công cụ tuổi đời mấy chục năm rồi nhưng mà vẫn rất mạnh. Viết bằng C, nguồn mở, dễ dàng cài đặt và thiết lập, tốn cực ít tài nguyên hệ thống. Về cơ bản thì Monit cho phép bạn thiết lập ngưỡng cảnh báo, nếu vượt qua thì nó tự động kích hoạt cảnh báo, có thể kể đến như 1 tiến trình đột nhiên biến mất, cổng (port) bị sập... và nhiều thiết lập khác nữa.

Vì có bề dày lịch sử như thế nên Monit có hẳn một trang "showcase" thế giới đang sử dụng nó như thế nào. Tham khảo tại Real-world configuration examples.

Ngày hôm qua mình dành buổi chiều để dùng AI tạo ra một bộ Skills cho AI Agents dùng.

Nếu như bạn đã từng phát triển tính năng trong hệ thống CMS vận hành quy trình/ứng dụng nào đó thì hẳn đã quá quen thuộc với danh sách tính năng mà bên khác yêu cầu. Đơn giản như là đội Marketing yêu cầu tính năng xem báo cáo mức độ hiệu quả của chiến dịch vừa diễn ra, hay yêu cầu tạo ra tính năng cho phép gửi email hàng loạt đến nhóm người dùng nào đó... Những lúc như vậy chúng ta lại bắt tay vào xây dựng tính năng với hiệu suất cao nhất có thể, tìm cách tối ưu rồi cả sao cho bên đó dễ dùng mà không cần phải thắc mắc gì nhiều.

Tính năng vừa làm hết sức đơn giản, nhận vào một danh sách người dùng, gọi API để cập nhật, báo cáo chi tiết số lượng thành công/thất bại. Thật ra cái này mình đã làm một lần rồi, nhưng nó bị lỗi không thể sử dụng được. Sau khi bỏ thời gian xem lại thì... bó tay, quá phức tạp và tốn kém nếu muốn viết lại. Sẵn AI Agents đang lên ngôi, cộng với phía công ty đang rất tích cực áp dụng AI vào công việc cho nên tạo ra một bộ Skills chuyên để làm công việc đó. Thế là chỉ với 1 tệp markdown, cộng với 1 tệp bash và vài prompts là giải quyết xong vấn đề. Cách dùng cũng rất đơn giản, bất kỳ công cụ nào hỗ trợ AI Agents, đọc được Skills là dùng được.

Đây có thể là tương lai cho cách vận hành CMS, không cần giao diện cầu kỳ, không cần nút bấm, tất cả mô tả bằng ngôn ngữ tự nhiên, kết quả trả về tự nhiên, rất thân thiện. Thực tế tất cả sức mạnh nằm trong tệp bash vì nó chứa logic xử lý, không cần AI Agents vẫn có thể gọi lệnh bash đó một cách thủ công, nhưng nếu thêm AI vào nó giúp ích hơn nhiều trong quá trình sử dụng vì không phải ai cũng biết dùng lệnh.

Nếu nghĩ xa hơn, mỗi tính năng trong CMS có thể gói gọn trong một bộ Skills, 1 tệp bash chứa logic chính hoặc mạnh hơn thì tạo ra luôn 1 ứng dụng cli chuyên xử lý logic nghiệp vụ. Đầu ra định nghĩa rõ ràng thì không chỉ AI đọc mà con người cũng có thể tận dụng nếu muốn xây dựng thêm giao diện hiển thị. Hồi xưa MCP sinh ra để làm nhiệm vụ lấy dữ liệu cho AI xử lý đấy chứ, cơ mà nó hơi phức tạp trong khi CLI lại tỏ ra thân thiện hơn nên mọi người lại đổ sang xây dựng CLI, mà tầm này thì xây cái gì cũng nhanh vì AI nó làm hết rồi, chỉ việc ngồi mô tả thôi. Lúc này hơn nhau ở chỗ kinh nghiệm triển khai hệ thống đấy mọi người 😄

Có thể nhiều người cần. Jina là một công ty nghiên cứu và cung cấp giải pháp liên quan đến ứng dụng của LLM. Mình biết đến nó khi tìm hiểu về các mô hình embedding trong tìm kiếm ngữ nghĩa (semantic search).

Ngoài ra họ cung cấp nhiều giải pháp khác, một trong đó là biến bất kỳ liên kết đến bài viết nào thành định dạng markdown để thân thiện hơn với LLM. Như bạn biết, định dạng .md đang trở nên phổ biến hơn bao giờ hết vì nó được dùng để cung cấp ngữ cảnh cho mô hình ngôn ngữ lớn xử lý thông tin. Giờ đây chỉ cần gọi một API thì dữ liệu bài viết nằm trong tầm tay.

Bảo sao Cloudflare rất tích cực trong việc chống AI "cào" dữ liệu từ web 😃

Qwen3.5 tiếp tục là cái tên đáng chú ý khi chỉ với mô hình 9B và 4B họ đã tự tin so sánh với gpt-oss-120b của OpenAI.

Còn với bản tham số cao hơn điểm số thậm chí còn vượt cả GPT 5.2 hay Opus 4.5. Nguồn mở. Thật đáng kinh ngạc 🫣