Tổng hợp một số nhà cung cấp API LLMs miễn phí

Vấn đề

Xin chào, có bao giờ bạn phải vật lộn với Google để tìm kiếm một nơi cho phép sử dụng miễn phí API của các mô hình ngôn ngữ lớn LLMs? Tôi đã từng như bạn, cố gắng tìm kiếm khắp nơi trên Internet nhưng chỉ để nhận ra là... không có nơi nào như vậy. Nhưng ít ra thì lại tìm thấy một số nhà cung cấp cho phép dùng thử API, hay nói cách khác là được dùng nhưng đi kèm với giới hạn nhất định trong ngày.

Rõ ràng rồi, thực tế thì LLMs cần có phần cứng đủ mạnh để phục vụ cho nhiều người dùng. Nếu "thả phanh" cho ai cũng có thể gọi được thì e rằng rất khó. Mục đích của việc giới hạn vừa có cái hay lại có cái dở. Hay ở chỗ mang nó tiếp cận được với nhiều người hơn, phục vụ cho mục đích nghiên cứu, sử dụng cá nhân là chính. Còn khi triển khai sản phẩm đến người dùng cuối thì nên tìm giải pháp lâu dài và ổn định hơn.

Dưới đây là một số nhà cung cấp API miễn phí trong giới hạn mà tôi đã sưu tầm được, nhưng với lưu ý rằng hạn mức có thể thay đổi trong tương lai. Có những cái đang áp dụng vào các dự án cá nhân. Nhìn chung chúng có tính ổn định tương đối cao và hạn mức thoải mái hay không thì tuỳ vào mục đích sử dụng của bạn. Còn đối với tôi như thế là đủ dùng. Dù sao thì là người dùng miễn phí nên không đòi hỏi gì hơn 😅, nếu có dùng quá lố thì chuyển qua lại giữa các dịch vụ 😎. Không nói nhiều nữa, bắt đầu thôi.

Github Models

Đây là dịch vụ tôi sử dụng thường xuyên trong dự án cá nhân. Github Models cho phép sử dụng rất nhiều mô hình ngôn ngữ lớn từ nguồn mở đến đóng mới nhất hiện nay, có thể kể đến như gpt-5, Grok, DeepSeek... Giới hạn sử dụng tuỳ thuộc vào mô hình, có các mốc như Low/High/Custom... Để biết thêm chi tiết, bạn đọc tham khảo Rate limits.

Điểm cộng là giới hạn "dễ thở", nhiều mô hình tân tiến, cập nhật nhanh chóng. Điểm trừ chí mạng là cắt bớt ngữ cảnh, hầu hết bị giới hạn ở 8000 tokens in, 4000 tokens out.

Thông tin chi tiết tại: Models.

OpenRouter

OpenRouter như là một đại lý phân phối lại dịch vụ từ nhiều nguồn cung cấp khác nhau, vậy nên họ có chương trình cho dùng thử miễn phí một số mô hình có tên kết thúc bằng :free. Nếu muốn sử dụng mô hình nào hãy thử tìm kiếm, nếu nó kết thúc bằng :free thì có thể dùng miễn phí.

Điểm cộng là có khá nhiều mô hình miễn phí ở trên này, nhưng hầu như không có sự góp mặt của những cái tên lớn như claude, gpt... Ngoài ra hạn mức cũng tương đối thấp, như chỉ có 50 yêu cầu một ngày. Nếu tài khoản từng mua ít nhất 10 credits, con số sẽ tăng lên đến 1000 yêu cầu.

Thông tin chi tiết tại: OpenRouter Pricing Plans.

Ollama Cloud

Ollama là cái tên không quá xa lạ. Nhiều người biết đến nó có lẽ về khả năng chạy các mô hình mã nguồn mở chỉ bằng một lệnh đơn giản. Ollama Cloud là dịch vụ mới nhất của họ, cho phép chạy các mô hình ngôn ngữ lớn trên đám mây, hay nói cách khác là gọi API để sử dụng mô hình.

Điểm cộng là với tài khoản miễn phí bạn có thể sử dụng một số mô hình nổi bật như deepseek 3.1, gpt-oss, qwen3-coder... với hạn mức thoải mái, vì như tài liệu công bố chưa có giới hạn cụ thể cho việc sử dụng này, chắc vì đang trong giai đoạn thu thập dữ liệu. Điểm trừ là chỉ có một vài mô hình mã nguồn mở được hỗ trợ.

Thông tin chi tiết tại: Ollama Cloud.

Vercel AI

Lại một cái tên nữa không mấy xa lạ, Vercel là một nhà cung cấp cho phép triển khai nhiều dịch vụ ở trên này, như một trang web hay API server... Vercel AI Gateway chỉ là một trong số đó, tuy nhiên họ rất "hào phóng" khi cho người dùng miễn phí 5$ tín dụng hàng tháng để gọi API.

Điểm cộng là với 5$ bạn có thể sử dụng hầu hết mô hình "hot hit" hiện nay, bao gồm cả claude (rất hiếm). Điểm trừ là phải thêm phương thức thanh toán vào tài khoản.

Thông tin chi tiết tại: Pricing.

Cerebras

Cái tên Cerebras đã được nhắc đến một vài lần trong blog. Cerebras là một trong những công ty đi đầu trong lĩnh vực cung cấp dịch vụ hay phần cứng cho tốc độ "nhả" tokens nhanh nhất. Một số mô hình mã nguồn mở mà họ cung cấp có thể chạy với tốc độ vài nghìn tokens/s. Thi thoảng họ hay lên bài viết khoe rằng máy chủ vừa đạt được tốc độ nhả tokens không thể tin nổi.

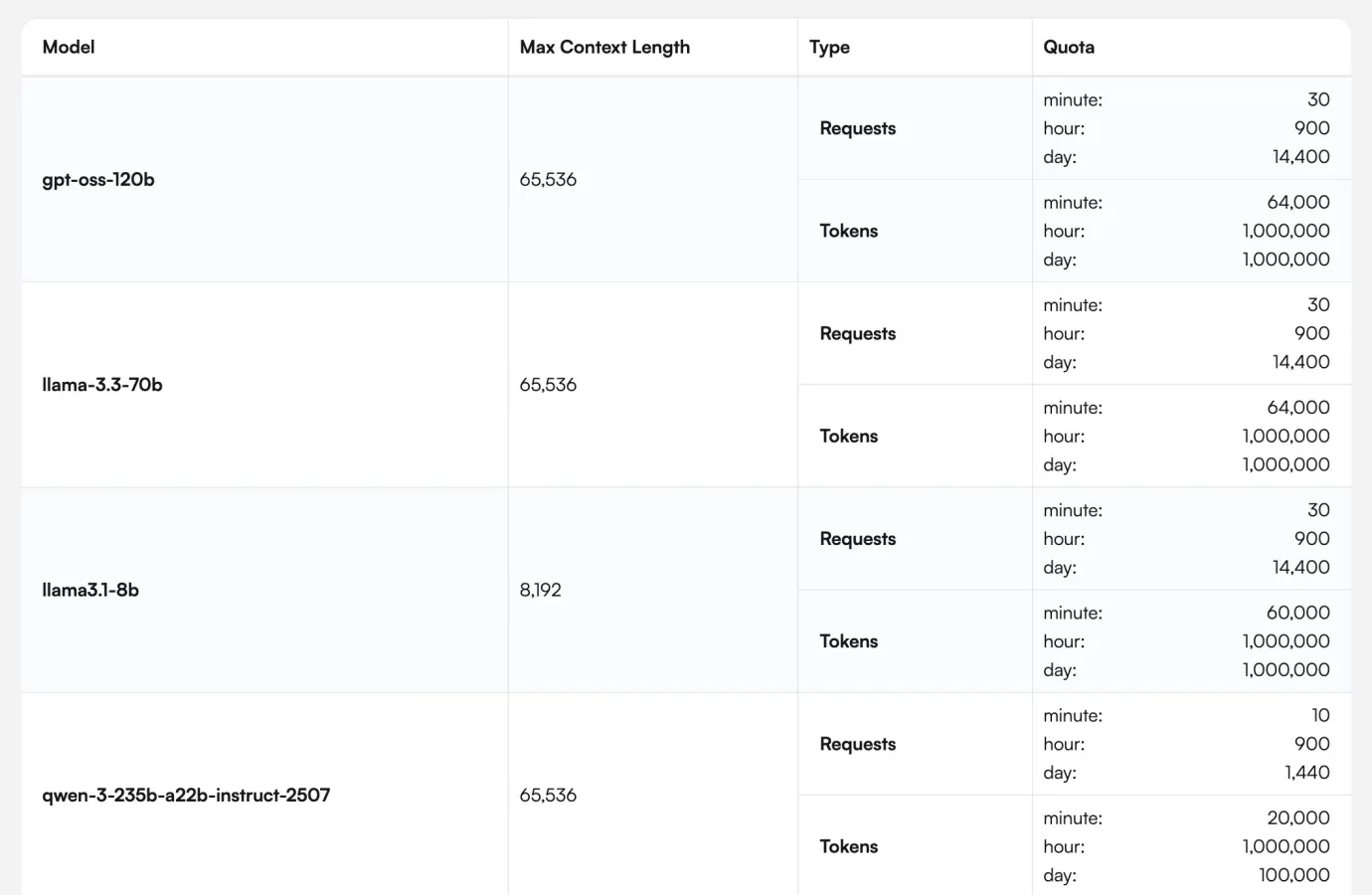

Điểm cộng là tốc độ phản hồi, lượng tokens tối đa trong ngày được phép sử dụng là 1 triệu, bên cạnh đó đi kèm với nhiều giới hạn liên quan đến tần suất gọi mỗi phút/giờ. Điểm trừ là mô hình không quá đa dạng, có một vài cái tên nổi bật là gpt-oss-120b, zai-glm-4.6 và qwen-3-235b.

Bạn đọc có thể tham khảo bảng giới hạn sử dụng dưới đây.

Groq

Nhắc đến Cerebras mà không nói đến Groq thì quả là một thiết sót. Groq tương tự như Cerebras là một nhà cung cấp dịch vụ phần cứng lẫn API thiên về tốc độ. Groq thi thoảng cũng lên bài khoe rằng mình chạy được mô hình với tốc độ chóng mặt.

Điểm cộng là tốc độ, mô hình mã nguồn mở đa dạng. Điểm trừ là hạn mức tokens không được nhiều cho lắm, với các mô hình như gpt-oss-120b chỉ dừng lại ở 200K hàng ngày. Nhưng nếu nâng cấp lên Developer thì hạn mức tăng lên 500K.

Thông tin chi tiết tại: Rate Limits.

Gemini API

Một con cá voi trong làng cung cấp API miễn phí. Nghe đâu nếu dùng trong Google AI Studio thì còn không bị mất phí. Còn nếu dùng API thì vẫn tính phí như thường.

Điểm cộng là gói miễn phí dùng được hầu hết mô hình hiện tại của Gemini, hạn mức được áp dụng cho từng mô hình tuỳ vào sức mạnh của nó. Có một số mô hình nhỏ gọn như Gemma 3n được dùng với giới hạn rất lớn. Điểm trừ là chỉ có mỗi mô hình của Gemini.

Thông tin chi tiết tại: Standard API rate limits.

Nvidia NIM

Cuối cùng là một cái tên sừng sỏ Nvidia NIM, đây là nhà cung cấp phần cứng hàng đầu cho các mô hình ngôn ngữ lớn. Bên cạnh đó là khả năng dùng thử một số mô hình LLMs nguồn mở.

Điểm cộng là có rất nhiều mô hình mã nguồn mở ở trên này. Tất cả giới hạn chỉ dừng lại ở 40 yêu cầu mỗi phút cho tất cả mô hình. Điểm trừ? Tất nhiên rồi, là sự vắng mặt của những cái tên hàng đầu hiện nay.

Thông tin chi tiết tại: Retrieval APIs.

Ngoài những cái tên ở trên, còn nhiều nhà cung cấp dịch vụ khác như Cloudflare AI, Together AI, Z.ai... Tuy nhiên qua trải nghiệm thực tế thấy còn nhiều hạn chế nên không liệt kê chi tiết trong bài viết.

Còn bạn thì sao? Đang sử dụng API của nhà cung cấp nào? Hoặc nếu biết thêm thì hãy để lại dưới phần bình luận nhé. Xin cảm ơn.